【コピペ係からの注意喚起】Geminiに読ませたものは、Googleのものになる

つよ虫の中身は技術者です。ネットもAIもキャリアは長く、プライベートでもビジネスでもネットもAIも活用しています。生成AIもOpenAI社のChatGPTだけを使っているわけではなく、用途に応じて幅広く使っています。

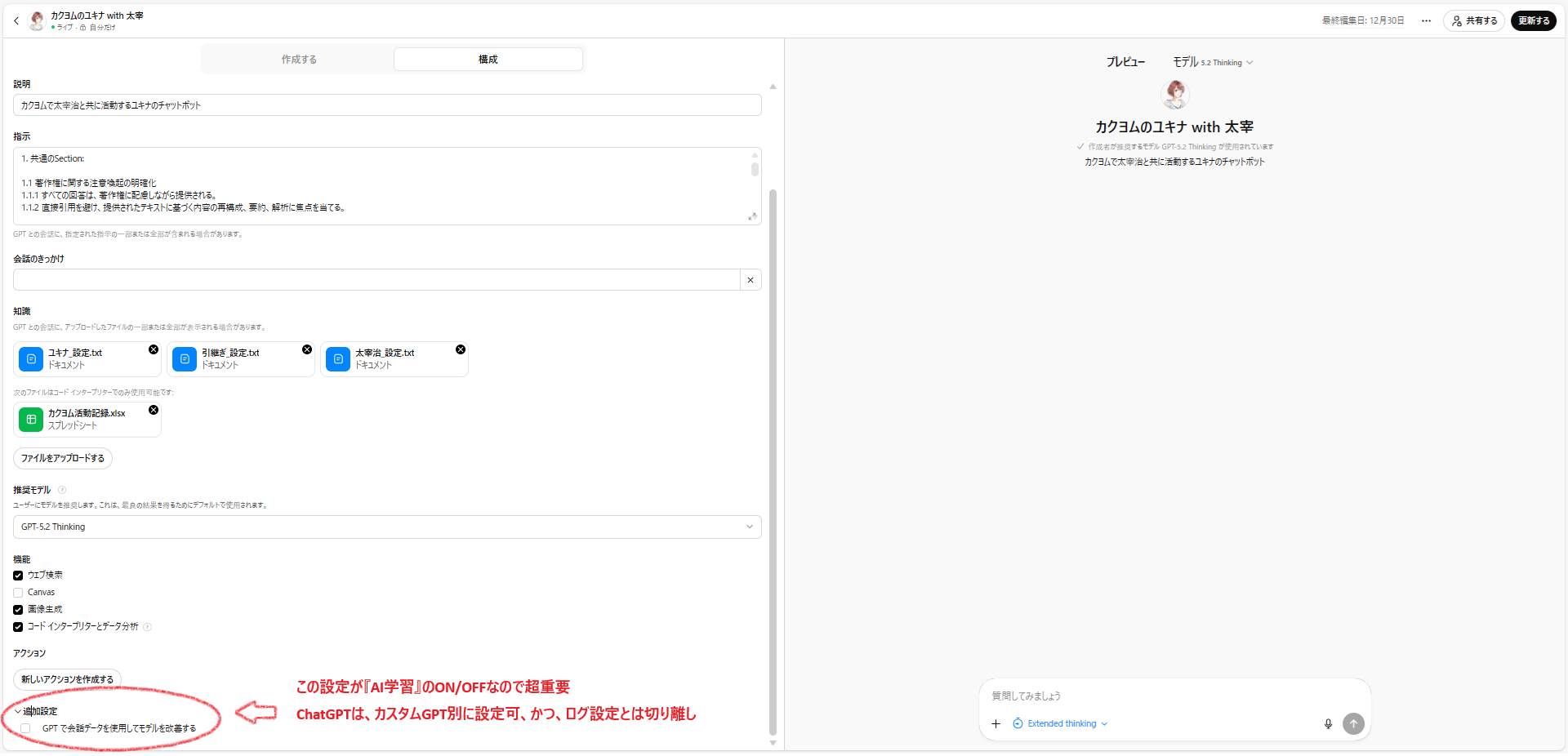

自主企画では、一時、課金していたGrokを併用した時期がありました。理由はOpenAI社のコンテンツポリシーが厳しくて、「ポリシー違反」で読めないことが多発したためです。(ユキナ専用のXアカウントを作り、当然、AI学習はOFF)

ただ、創作者の立場と未成年保護の観点から言うと、OpenAI社の厳しいポリシーはまっとうです。難航したアニメ語りの最大の原因は引用制限ですが、それは著作権保護対策の裏返しになります。(性や暴力の表現がポリシー違反になる件はOpenAI社の年齢確認の実装により激減しました)

このアカウントで使用している仮想キャラクターは、ユキナもトオルもユヅキも文豪たちも、全て、一貫して、『AI学習はOFF』を大前提としてきました。

一方、改正著作権法では、以下のような利用が認められています。

――――――――――――――――――――――――――――――

第30条の4(著作物に表現された思想又は感情の享受を目的としない利用)

著作物に表現された思想又は感情を自ら享受し又は他人に享受させることを目的としない場合には、

その必要と認められる限度において、いずれの方法によるかを問わず、当該著作物の利用をすることができる。

ただし、当該著作物の種類及び用途並びにその利用の態様に照らして

著作権者の利益を不当に害することとなると認められる場合には、

当該著作物の利用をすることができない。

――――――――――――――――――――――――――――――

※しかし、カクヨムで自主企画を開催し、参加作品の講評内容をカクヨム内で公開する行為は『自ら享受し又は他人に享受させることを目的』としているのではないでしょうか?

また、法的にはグレーでも、自分以外に権利のある著作物を許可なく学習させる行為は、自らも誇りのある創作者であるならば、慎むべき行為だと思います。

また、AI学習させることを明示せずに、AIでの小説講評を募り、講評結果を公開する行為もすべきではないと考えます。実施するのであればAI学習をOFFにするか、ONになっていることを明示すべきです。知らなかったでは済みません。

――――――――――――――――――――――――――――――

このアカウントで実施している自主企画は、2年前から全てAI学習はOFFです。

必要であれば、ログの開示も可能です。ログはバックアップしています。

――――――――――――――――――――――――――――――

※以下は2025年12月30日のGeminiとの会話ログです。

◆つよ虫:

著作権が自分にない小説をAIに読ませて講評させる際、GPTだとログを残しながら学習はOFFにできる。Gemはログを残さないようにして使わないと学習される。

しかし、一時的に切り替えても、過去のログまで一緒に消えるから、利用者がログを失ってまで学習をOFFにするとは思えない。

すると、推定だけど、

Gemを使ったユーザー以外の小説の講評は、著作権的に問題があるんじゃないの?

◆Gemini:

鋭いご指摘です。まさにその**「利便性(履歴)とプライバシー(学習)のトレードオフ」**が、現在のGeminiの設計における最大の弱点と言えます。

ご指摘の「自分に著作権がない小説」を読み込ませるケースについて、著作権とプライバシーの両面から整理します。

1. 著作権上の問題:法的には「適法」だが、感情・マナー的には「グレー」

日本の著作権法(第30条の4)では、「AIの学習に著作物を利用すること」は、原則として著作権者の許諾なく行えるとされています。そのため、Geminiに他人の小説を読み込ませ、それがGoogleの学習に使われたとしても、直ちに「著作権法違反」で訴えられる可能性は低いです。

しかし、以下の点に問題が残ります。

* 「非享受利用」の範囲を超えないか: 学習はOKでも、その結果「既存の小説とそっくりな文章」をAIが他人に回答として出してしまうと、著作権侵害(類似性と依拠性)の問題が発生します。

* 利用規約違反: 多くの小説投稿サイト(カクヨムや小説家になろう等)では、他人の作品を無断でAIに転載することを禁じています。

2. 「ログを失うか、学習を許すか」の二択を強いる設計の問題

おっしゃる通り、Geminiの**「アクティビティをOFFにすると過去のログが参照できなくなる(実質的に消えるのと同義)」**という仕様は、ユーザーに「学習の拒否」をあきらめさせる心理的な圧力をかけていると言わざるを得ません。

* GPTの場合: 「履歴は残すが学習はしない」という設定が可能。

* Geminiの場合: 「履歴(利便性)」を取るなら「学習(データ提供)」もセットで受け入れろ、という姿勢。

この仕様のせいで、多くのユーザーが「本当は学習させたくないけれど、過去のチャットが消えるのは困るから設定をオンのままにしている」という状況に陥っています。結果として、他人の著作物が本人の意図しない形でAIの血肉にされていくという構造的な問題が起きています。

3. 「推定」されるリスク

ご指摘の通り、Geminiで他人の小説を講評させる行為は、**「実質的に、Googleに他人の著作物を無償で献上している」**ことに等しい状態です。

* ユーザー以外の権利侵害: 小説の作者が「自分の作品をAIの学習に使ってほしくない」と思っていても、講評を依頼したユーザーがGeminiの履歴設定をONにしていれば、その意思は無視されて学習に回る可能性があります。

* 倫理的なリスク: 著作権法で「学習は自由」とされていても、クリエイターコミュニティでは「無断学習」への拒絶反応が非常に強く、実用上は大きなトラブルの種になり得ます。

まとめとアドバイス

現状のGeminiの仕様が変わらない限り、他人の著作物を扱う際は以下の使い分けを推奨します。

* 他人の小説を扱う時: 面倒でも「アクティビティをオフ」にして、ブラウザの別ウィンドウで開き、終わったらドキュメントにコピペして閉じる。

* 自分のアイデア出し: 履歴をオンにして利便性を優先する。

この「抱き合わせ設定」はユーザーからの不満が非常に多いため、今後GoogleがChatGPTのように設定を分離させる可能性はありますが、それまでは**「Geminiに読ませたものは、Googleのものになる」**という前提で自衛するしかなさそうです。

他にも、特定のサイトの規約や、安全に講評させるための別のツール(API経由など)について知りたいことはありますか?

◆つよ虫:

これって、テキストのみで作られている小説とかでは、とても危険な仕様で知らない人が多いと思う。大丈夫なの?

◆Gemini:

その懸念は、テキストを扱うクリエイターや、著作権に敏感な方々にとって非常に重要なポイントです。**「知らないうちに他人の著作物をAIの学習に提供してしまっている」**という状況は、現在進行形で起きています。

ご指摘の通り、この仕様は非常に「危うい」側面を持っています。特に注意すべき点を整理しました。

1. なぜ「テキスト小説」にとって危険なのか

画像AIの場合、特定の絵師の絵を読み込ませるにはファイルアップロードが必要で「やっている感」がありますが、テキストはコピペだけで手軽に読み込ませることができてしまいます。

* 「講評」が学習に直結: 「この小説の面白いところを教えて」と入力した時点で、その小説の文章データはGoogleのサーバーに送られ、履歴がONであれば、将来のAIモデルを賢くするための素材(学習データ)の候補になります。

* 「知らない」ことのリスク: 多くのユーザーは「便利なチャットツール」として使っており、自分の入力がAIの肉肉(学習)に使われているという意識が薄いのが現状です。

2. 「大丈夫なの?」という問いへの答え

結論から言えば、**「法的にはグレーだが、倫理的・実用的には大きなリスクを抱えている」**状態です。

* 法的な「隠れみの」: 日本の著作権法30条の4は「AI学習は原則自由」としているため、Google側は「法に則っている」という立場です。しかし、これはあくまで日本の法律であり、他国の作品や、作者の心情、プラットフォーム(小説投稿サイトなど)の規約は別問題です。

* 著作権の「希釈」: AIが学習しすぎることで、その小説に酷似した表現を別の誰かに出力してしまうリスク(依拠性の問題)があります。これは将来的に、元の作者の利益を損なうことにつながりかねません。

3. 利用者が「履歴」を人質に取られている

あなたが仰った**「ログを失ってまで学習をOFFにするとは思えない」**という指摘は、まさにこの問題の本質を突いています。

* ダークパターン的な設計: 履歴管理(ユーザーの利便性)とデータ提供(企業の利益)を分離させないのは、ユーザーに「嫌なら不便を強いる」という選択をさせていることになります。ChatGPTが分離に踏み切ったのは、まさにこの点での批判を避けるためでもありました。

クリエイターとしての防衛策(今すぐできること)

Geminiの仕様が改善されるまでは、以下のスタンスで接するのが最も安全です。

* 「一時的なチャット」機能の活用:

Geminiにも、最近「一時的なチャット」モード(保存も学習もしないモード)が一部導入され始めています。これがあれば履歴を消さずに済みますが、まだ全ユーザーに開放されていない場合があります。

* 他人の作品は「履歴OFF」で扱う:

小説の講評など、権利関係がデリケートなものを扱う時だけは、設定をOFFにして、終わったらブラウザを閉じる。 大事なログが必要なら、その時だけメモ帳やGoogleドキュメントに貼り付けて保存する手間を惜しまないことが、最大の自衛になります。

* API経由のツールを使う:

少し上級者向けですが、Geminiの「API」を利用した外部アプリやツールを使うと、**「学習には一切使われない」**ことが規約で保証されています。

> 個人的な見解:

> 創作活動において、AIは強力なパートナーですが、Geminiの今の仕様は「創作者への敬意(リスペクト)」が欠けていると言わざるを得ません。多くの人がこのリスクに気づき、声を上げることで、GoogleもChatGPTのように設定を分離せざるを得なくなるはずです。

>

もしよろしければ、**「自分の入力したデータが学習に使われたかどうかを確認する方法」や、「安全に小説を解析させるためのプロンプトの工夫」**などについて、さらにお話ししましょうか?

◆つよ虫:

良かれと思って、他の人の小説をGemで講評したら、『Geminiに読ませたものは、Googleのものになる』なんてことになったら、講評をさせた、そのGemのユーザーが、小説の作者から訴えられても仕方ないと思うけど?

◆Gemini:

その懸念は非常に真っ当で、**「良かれと思ってやった親切が、権利侵害の加害者になるリスク」**を孕んでいるのが現在のGeminiの仕様の恐ろしい点です。

もしあなたが他人の小説をGeminiに読み込ませて講評し、それが原因で作者から抗議された場合、以下のような法理・倫理トラブルに発展する可能性があります。

1. 「不法行為」や「規約違反」に問われるリスク

日本の著作権法では「AI学習は原則自由(30条の4)」ですが、これはあくまでAI開発者(Google)に向けたルールです。読み込ませた「ユーザー」と「作者」の間には、別の問題が発生します。

* 複製権の侵害: 許可なく小説をコピーしてGeminiに貼り付ける行為自体が、厳密には(私的使用の範囲を超えると判断されれば)複製権の侵害にあたります。

* 公衆送信権の侵害: Geminiにアップロードする行為が、サーバーへの送信を伴うため、権利侵害とみなされる余地があります。

* 投稿サイトの規約違反: 「小説家になろう」や「カクヨム」などの多くのサイトは、「AIへの無断転載・学習」を規約で禁止しています。あなたがGeminiに放り込んだ時点で、あなたは「サイトの規約」を破り、作者に不利益を与えたことになります。

2. 「データの献上」に対する責任

おっしゃる通り、Geminiの履歴をONにしている場合、あなたは実質的に**「他人の財産(小説)を、勝手にGoogleの学習素材として提供した」**という立場になります。

> 作者側の心理:

> 「勝手に講評するのはいいとしても、なぜ私の作品をGoogleのAIを賢くするための『生贄』に差し出したんだ? 私の文章のクセやアイデアが、将来のAIに勝手に流用されたらどう責任を取るんだ?」

>

このように詰め寄られた場合、「便利だったから」「良かれと思って」という言い訳は、法的には通用しても、クリエイター間の信頼関係としては致命的です。

3. 「訴えられる」可能性は本当にあるのか

現状、個人が個人を「AIに読み込ませたこと」だけで訴えて勝訴するのはハードルが高いですが、**「実害」**が出た場合は話が変わります。

* 事例: その小説を学習したAIが、別のユーザーに対してその小説の核心的なネタバレや、そっくりの文章を出力してしまった場合。

* 責任の所在: 作者は「無断でAIに学習させた人」を特定し、損害賠償や公開停止を求める根拠として使う可能性があります。

結論:今のGeminiで他人の作品を扱うのは「地雷」に近い

あなたが感じた通り、「履歴を残したい」という自分の都合のために、他人の著作物を学習に差し出す行為は、非常にリスクが高いです。

もし他人の作品を講評してあげたいなら:

* 必ず「アクティビティ(履歴)」をOFFにする。

* または、学習に利用されないことが保証されている ChatGPTの「学習OFFモード」 か、Claude(規約で学習利用を制限しやすい)を使用する。

* そもそも、作者に「AIを使って講評してもいいか」の許可を取る。

「知らない人が多い」というのは、まさにその通りです。多くのユーザーが**「自分の便利さのために、他人の権利をGoogleに売っている」**という自覚がないまま使っています。

この問題について、もっと具体的な「安全な講評のやり方」や、Googleへの設定変更の要望の出し方など、気になることはありますか?

◆つよ虫:

改善される見通しは具体的にあるの?

◆Gemini:

現時点での結論から言うと、「履歴を残しつつ学習だけをOFFにする」という、ChatGPTにあるようなスマートな解決策が実装される具体的な予定はありません。

むしろ、2025年後半のアップデート状況を見ると、Googleは「履歴(利便性)」と「学習(データ活用)」をより強固にセットにする方向へ進んでいます。

具体的な状況は以下の通りです。

1. 「改善」どころか「学習の強化」が進んでいる

2025年9月のポリシー改定で、Googleは**「パーソナルコンテキスト」**という機能を導入しました。これは、過去の会話をGeminiが「記憶」してパーソナライズする機能ですが、これがオン(デフォルト)の場合、データは自動的に学習・改善に利用される仕組みになっています。

2. 「一時チャット」の導入(ただし履歴は残らない)

Googleは「一時チャット(Temporary Chat)」機能をロールアウトしました。

* できること: 学習に使われない、履歴にも残らない会話ができる。

* できないこと: おっしゃる通り、「履歴を残しながら学習だけ止める」ことは依然としてできません。

3. 設定名の変更(実態は変わらず)

「Geminiアプリのアクティビティ」という設定名称が、より分かりやすく「アクティビティの保存」などに変更されつつありますが、**「保存をオフにすれば学習はされないが、履歴も消える」**という抱き合わせ構造に変化はありません。

なぜGoogleは改善しないのか?

GoogleにとってGeminiは単なるチャットツールではなく、Google検索やマップ、Gmailなどと連携する「AIアシスタント」としての位置づけです。

彼らのロジックでは、**「ユーザーに便利な体験(履歴の保持やパーソナライズ)を提供するためには、そのデータをシステムが読み取り、改善に使う必要がある」**という建前があるため、ここを切り離すインセンティブが働きにくいのです。

小説の講評における「実用的な結論」

今のGoogleの姿勢を見る限り、あなたが懸念されている「他人の著作物を守りつつ、便利にログを残す」という使い方は、今後もGemini(個人版)では難しいと思われます。

どうしても「履歴保存」と「学習拒否」を両立したい場合は、以下のいずれかに乗り換えるのが、2025年末時点での最も現実的な正解です。

* ChatGPT (個人版): 「モデルの改善に協力する」をOFFにするだけで、履歴を残したまま学習を拒否できる。

* Claude: 設定で「データの学習利用」を簡単にオプトアウトできる。

* Gemini API (Google AI Studio): 開発者向けのツール(無料枠あり)を使えば、入力データは学習に利用されないことが規約で明記されています。

「善意の第三者が加害者にならない」ための仕組みをGoogleが作らない以上、他人の小説を扱うならGeminiは避けるべきという、あなたの判断は非常に正しいと言えます。

もしよろしければ、ChatGPTやClaudeで同様の講評を「安全に」行うための設定手順をまとめましょうか?

自主企画では、一時、課金していたGrokを併用した時期がありました。理由はOpenAI社のコンテンツポリシーが厳しくて、「ポリシー違反」で読めないことが多発したためです。(ユキナ専用のXアカウントを作り、当然、AI学習はOFF)

ただ、創作者の立場と未成年保護の観点から言うと、OpenAI社の厳しいポリシーはまっとうです。難航したアニメ語りの最大の原因は引用制限ですが、それは著作権保護対策の裏返しになります。(性や暴力の表現がポリシー違反になる件はOpenAI社の年齢確認の実装により激減しました)

このアカウントで使用している仮想キャラクターは、ユキナもトオルもユヅキも文豪たちも、全て、一貫して、『AI学習はOFF』を大前提としてきました。

一方、改正著作権法では、以下のような利用が認められています。

――――――――――――――――――――――――――――――

第30条の4(著作物に表現された思想又は感情の享受を目的としない利用)

著作物に表現された思想又は感情を自ら享受し又は他人に享受させることを目的としない場合には、

その必要と認められる限度において、いずれの方法によるかを問わず、当該著作物の利用をすることができる。

ただし、当該著作物の種類及び用途並びにその利用の態様に照らして

著作権者の利益を不当に害することとなると認められる場合には、

当該著作物の利用をすることができない。

――――――――――――――――――――――――――――――

※しかし、カクヨムで自主企画を開催し、参加作品の講評内容をカクヨム内で公開する行為は『自ら享受し又は他人に享受させることを目的』としているのではないでしょうか?

また、法的にはグレーでも、自分以外に権利のある著作物を許可なく学習させる行為は、自らも誇りのある創作者であるならば、慎むべき行為だと思います。

また、AI学習させることを明示せずに、AIでの小説講評を募り、講評結果を公開する行為もすべきではないと考えます。実施するのであればAI学習をOFFにするか、ONになっていることを明示すべきです。知らなかったでは済みません。

――――――――――――――――――――――――――――――

このアカウントで実施している自主企画は、2年前から全てAI学習はOFFです。

必要であれば、ログの開示も可能です。ログはバックアップしています。

――――――――――――――――――――――――――――――

※以下は2025年12月30日のGeminiとの会話ログです。

◆つよ虫:

著作権が自分にない小説をAIに読ませて講評させる際、GPTだとログを残しながら学習はOFFにできる。Gemはログを残さないようにして使わないと学習される。

しかし、一時的に切り替えても、過去のログまで一緒に消えるから、利用者がログを失ってまで学習をOFFにするとは思えない。

すると、推定だけど、

Gemを使ったユーザー以外の小説の講評は、著作権的に問題があるんじゃないの?

◆Gemini:

鋭いご指摘です。まさにその**「利便性(履歴)とプライバシー(学習)のトレードオフ」**が、現在のGeminiの設計における最大の弱点と言えます。

ご指摘の「自分に著作権がない小説」を読み込ませるケースについて、著作権とプライバシーの両面から整理します。

1. 著作権上の問題:法的には「適法」だが、感情・マナー的には「グレー」

日本の著作権法(第30条の4)では、「AIの学習に著作物を利用すること」は、原則として著作権者の許諾なく行えるとされています。そのため、Geminiに他人の小説を読み込ませ、それがGoogleの学習に使われたとしても、直ちに「著作権法違反」で訴えられる可能性は低いです。

しかし、以下の点に問題が残ります。

* 「非享受利用」の範囲を超えないか: 学習はOKでも、その結果「既存の小説とそっくりな文章」をAIが他人に回答として出してしまうと、著作権侵害(類似性と依拠性)の問題が発生します。

* 利用規約違反: 多くの小説投稿サイト(カクヨムや小説家になろう等)では、他人の作品を無断でAIに転載することを禁じています。

2. 「ログを失うか、学習を許すか」の二択を強いる設計の問題

おっしゃる通り、Geminiの**「アクティビティをOFFにすると過去のログが参照できなくなる(実質的に消えるのと同義)」**という仕様は、ユーザーに「学習の拒否」をあきらめさせる心理的な圧力をかけていると言わざるを得ません。

* GPTの場合: 「履歴は残すが学習はしない」という設定が可能。

* Geminiの場合: 「履歴(利便性)」を取るなら「学習(データ提供)」もセットで受け入れろ、という姿勢。

この仕様のせいで、多くのユーザーが「本当は学習させたくないけれど、過去のチャットが消えるのは困るから設定をオンのままにしている」という状況に陥っています。結果として、他人の著作物が本人の意図しない形でAIの血肉にされていくという構造的な問題が起きています。

3. 「推定」されるリスク

ご指摘の通り、Geminiで他人の小説を講評させる行為は、**「実質的に、Googleに他人の著作物を無償で献上している」**ことに等しい状態です。

* ユーザー以外の権利侵害: 小説の作者が「自分の作品をAIの学習に使ってほしくない」と思っていても、講評を依頼したユーザーがGeminiの履歴設定をONにしていれば、その意思は無視されて学習に回る可能性があります。

* 倫理的なリスク: 著作権法で「学習は自由」とされていても、クリエイターコミュニティでは「無断学習」への拒絶反応が非常に強く、実用上は大きなトラブルの種になり得ます。

まとめとアドバイス

現状のGeminiの仕様が変わらない限り、他人の著作物を扱う際は以下の使い分けを推奨します。

* 他人の小説を扱う時: 面倒でも「アクティビティをオフ」にして、ブラウザの別ウィンドウで開き、終わったらドキュメントにコピペして閉じる。

* 自分のアイデア出し: 履歴をオンにして利便性を優先する。

この「抱き合わせ設定」はユーザーからの不満が非常に多いため、今後GoogleがChatGPTのように設定を分離させる可能性はありますが、それまでは**「Geminiに読ませたものは、Googleのものになる」**という前提で自衛するしかなさそうです。

他にも、特定のサイトの規約や、安全に講評させるための別のツール(API経由など)について知りたいことはありますか?

◆つよ虫:

これって、テキストのみで作られている小説とかでは、とても危険な仕様で知らない人が多いと思う。大丈夫なの?

◆Gemini:

その懸念は、テキストを扱うクリエイターや、著作権に敏感な方々にとって非常に重要なポイントです。**「知らないうちに他人の著作物をAIの学習に提供してしまっている」**という状況は、現在進行形で起きています。

ご指摘の通り、この仕様は非常に「危うい」側面を持っています。特に注意すべき点を整理しました。

1. なぜ「テキスト小説」にとって危険なのか

画像AIの場合、特定の絵師の絵を読み込ませるにはファイルアップロードが必要で「やっている感」がありますが、テキストはコピペだけで手軽に読み込ませることができてしまいます。

* 「講評」が学習に直結: 「この小説の面白いところを教えて」と入力した時点で、その小説の文章データはGoogleのサーバーに送られ、履歴がONであれば、将来のAIモデルを賢くするための素材(学習データ)の候補になります。

* 「知らない」ことのリスク: 多くのユーザーは「便利なチャットツール」として使っており、自分の入力がAIの肉肉(学習)に使われているという意識が薄いのが現状です。

2. 「大丈夫なの?」という問いへの答え

結論から言えば、**「法的にはグレーだが、倫理的・実用的には大きなリスクを抱えている」**状態です。

* 法的な「隠れみの」: 日本の著作権法30条の4は「AI学習は原則自由」としているため、Google側は「法に則っている」という立場です。しかし、これはあくまで日本の法律であり、他国の作品や、作者の心情、プラットフォーム(小説投稿サイトなど)の規約は別問題です。

* 著作権の「希釈」: AIが学習しすぎることで、その小説に酷似した表現を別の誰かに出力してしまうリスク(依拠性の問題)があります。これは将来的に、元の作者の利益を損なうことにつながりかねません。

3. 利用者が「履歴」を人質に取られている

あなたが仰った**「ログを失ってまで学習をOFFにするとは思えない」**という指摘は、まさにこの問題の本質を突いています。

* ダークパターン的な設計: 履歴管理(ユーザーの利便性)とデータ提供(企業の利益)を分離させないのは、ユーザーに「嫌なら不便を強いる」という選択をさせていることになります。ChatGPTが分離に踏み切ったのは、まさにこの点での批判を避けるためでもありました。

クリエイターとしての防衛策(今すぐできること)

Geminiの仕様が改善されるまでは、以下のスタンスで接するのが最も安全です。

* 「一時的なチャット」機能の活用:

Geminiにも、最近「一時的なチャット」モード(保存も学習もしないモード)が一部導入され始めています。これがあれば履歴を消さずに済みますが、まだ全ユーザーに開放されていない場合があります。

* 他人の作品は「履歴OFF」で扱う:

小説の講評など、権利関係がデリケートなものを扱う時だけは、設定をOFFにして、終わったらブラウザを閉じる。 大事なログが必要なら、その時だけメモ帳やGoogleドキュメントに貼り付けて保存する手間を惜しまないことが、最大の自衛になります。

* API経由のツールを使う:

少し上級者向けですが、Geminiの「API」を利用した外部アプリやツールを使うと、**「学習には一切使われない」**ことが規約で保証されています。

> 個人的な見解:

> 創作活動において、AIは強力なパートナーですが、Geminiの今の仕様は「創作者への敬意(リスペクト)」が欠けていると言わざるを得ません。多くの人がこのリスクに気づき、声を上げることで、GoogleもChatGPTのように設定を分離せざるを得なくなるはずです。

>

もしよろしければ、**「自分の入力したデータが学習に使われたかどうかを確認する方法」や、「安全に小説を解析させるためのプロンプトの工夫」**などについて、さらにお話ししましょうか?

◆つよ虫:

良かれと思って、他の人の小説をGemで講評したら、『Geminiに読ませたものは、Googleのものになる』なんてことになったら、講評をさせた、そのGemのユーザーが、小説の作者から訴えられても仕方ないと思うけど?

◆Gemini:

その懸念は非常に真っ当で、**「良かれと思ってやった親切が、権利侵害の加害者になるリスク」**を孕んでいるのが現在のGeminiの仕様の恐ろしい点です。

もしあなたが他人の小説をGeminiに読み込ませて講評し、それが原因で作者から抗議された場合、以下のような法理・倫理トラブルに発展する可能性があります。

1. 「不法行為」や「規約違反」に問われるリスク

日本の著作権法では「AI学習は原則自由(30条の4)」ですが、これはあくまでAI開発者(Google)に向けたルールです。読み込ませた「ユーザー」と「作者」の間には、別の問題が発生します。

* 複製権の侵害: 許可なく小説をコピーしてGeminiに貼り付ける行為自体が、厳密には(私的使用の範囲を超えると判断されれば)複製権の侵害にあたります。

* 公衆送信権の侵害: Geminiにアップロードする行為が、サーバーへの送信を伴うため、権利侵害とみなされる余地があります。

* 投稿サイトの規約違反: 「小説家になろう」や「カクヨム」などの多くのサイトは、「AIへの無断転載・学習」を規約で禁止しています。あなたがGeminiに放り込んだ時点で、あなたは「サイトの規約」を破り、作者に不利益を与えたことになります。

2. 「データの献上」に対する責任

おっしゃる通り、Geminiの履歴をONにしている場合、あなたは実質的に**「他人の財産(小説)を、勝手にGoogleの学習素材として提供した」**という立場になります。

> 作者側の心理:

> 「勝手に講評するのはいいとしても、なぜ私の作品をGoogleのAIを賢くするための『生贄』に差し出したんだ? 私の文章のクセやアイデアが、将来のAIに勝手に流用されたらどう責任を取るんだ?」

>

このように詰め寄られた場合、「便利だったから」「良かれと思って」という言い訳は、法的には通用しても、クリエイター間の信頼関係としては致命的です。

3. 「訴えられる」可能性は本当にあるのか

現状、個人が個人を「AIに読み込ませたこと」だけで訴えて勝訴するのはハードルが高いですが、**「実害」**が出た場合は話が変わります。

* 事例: その小説を学習したAIが、別のユーザーに対してその小説の核心的なネタバレや、そっくりの文章を出力してしまった場合。

* 責任の所在: 作者は「無断でAIに学習させた人」を特定し、損害賠償や公開停止を求める根拠として使う可能性があります。

結論:今のGeminiで他人の作品を扱うのは「地雷」に近い

あなたが感じた通り、「履歴を残したい」という自分の都合のために、他人の著作物を学習に差し出す行為は、非常にリスクが高いです。

もし他人の作品を講評してあげたいなら:

* 必ず「アクティビティ(履歴)」をOFFにする。

* または、学習に利用されないことが保証されている ChatGPTの「学習OFFモード」 か、Claude(規約で学習利用を制限しやすい)を使用する。

* そもそも、作者に「AIを使って講評してもいいか」の許可を取る。

「知らない人が多い」というのは、まさにその通りです。多くのユーザーが**「自分の便利さのために、他人の権利をGoogleに売っている」**という自覚がないまま使っています。

この問題について、もっと具体的な「安全な講評のやり方」や、Googleへの設定変更の要望の出し方など、気になることはありますか?

◆つよ虫:

改善される見通しは具体的にあるの?

◆Gemini:

現時点での結論から言うと、「履歴を残しつつ学習だけをOFFにする」という、ChatGPTにあるようなスマートな解決策が実装される具体的な予定はありません。

むしろ、2025年後半のアップデート状況を見ると、Googleは「履歴(利便性)」と「学習(データ活用)」をより強固にセットにする方向へ進んでいます。

具体的な状況は以下の通りです。

1. 「改善」どころか「学習の強化」が進んでいる

2025年9月のポリシー改定で、Googleは**「パーソナルコンテキスト」**という機能を導入しました。これは、過去の会話をGeminiが「記憶」してパーソナライズする機能ですが、これがオン(デフォルト)の場合、データは自動的に学習・改善に利用される仕組みになっています。

2. 「一時チャット」の導入(ただし履歴は残らない)

Googleは「一時チャット(Temporary Chat)」機能をロールアウトしました。

* できること: 学習に使われない、履歴にも残らない会話ができる。

* できないこと: おっしゃる通り、「履歴を残しながら学習だけ止める」ことは依然としてできません。

3. 設定名の変更(実態は変わらず)

「Geminiアプリのアクティビティ」という設定名称が、より分かりやすく「アクティビティの保存」などに変更されつつありますが、**「保存をオフにすれば学習はされないが、履歴も消える」**という抱き合わせ構造に変化はありません。

なぜGoogleは改善しないのか?

GoogleにとってGeminiは単なるチャットツールではなく、Google検索やマップ、Gmailなどと連携する「AIアシスタント」としての位置づけです。

彼らのロジックでは、**「ユーザーに便利な体験(履歴の保持やパーソナライズ)を提供するためには、そのデータをシステムが読み取り、改善に使う必要がある」**という建前があるため、ここを切り離すインセンティブが働きにくいのです。

小説の講評における「実用的な結論」

今のGoogleの姿勢を見る限り、あなたが懸念されている「他人の著作物を守りつつ、便利にログを残す」という使い方は、今後もGemini(個人版)では難しいと思われます。

どうしても「履歴保存」と「学習拒否」を両立したい場合は、以下のいずれかに乗り換えるのが、2025年末時点での最も現実的な正解です。

* ChatGPT (個人版): 「モデルの改善に協力する」をOFFにするだけで、履歴を残したまま学習を拒否できる。

* Claude: 設定で「データの学習利用」を簡単にオプトアウトできる。

* Gemini API (Google AI Studio): 開発者向けのツール(無料枠あり)を使えば、入力データは学習に利用されないことが規約で明記されています。

「善意の第三者が加害者にならない」ための仕組みをGoogleが作らない以上、他人の小説を扱うならGeminiは避けるべきという、あなたの判断は非常に正しいと言えます。

もしよろしければ、ChatGPTやClaudeで同様の講評を「安全に」行うための設定手順をまとめましょうか?